Le Scienze Cognitive rappresentano un’avventura intellettuale affascinante e un’area ricca di produzione di conoscenza dedicata al funzionamento della mente umana. Il Cognitivismo, con il suo focus sull’analisi dei processi di pensiero, si rivela un pilastro fondamentale nel plasmare questo campo di studio, che si concentra sulla comprensione del pensiero e della cognizione attraverso la lente delle strutture rappresentazionali nella mente e delle procedure computazionali che operano su tali strutture. La scienza cognitiva è emersa all’inizio degli anni ’50 come un campo interdisciplinare che integrava idee di psicologia, intelligenza artificiale, linguistica, neuroscienze e antropologia, un insieme sciolto di studiosi interessati allo studio della mente.

Il Cognitivismo: Un Nuovo Paradigma per lo Studio della Mente

Al centro delle Scienze Cognitive si erge la psicologia cognitiva, un approccio emerso negli anni ’50 con figure chiave come Miller, Simon e Chomsky, che hanno contribuito alle teorie sulla memoria, il problem solving e il linguaggio. Questo paradigma ha spostato l'attenzione dagli elementi osservabili dall'esterno, tipici del comportamentismo, verso la dimensione interna dell’uomo: la mente. Il Cognitivismo introduce concetti chiave come l’elaborazione dell’informazione, concependo la mente come un sofisticato elaboratore di dati, con un’organizzazione sequenziale e una capacità limitata di elaborazione. La psicologia cognitiva si interessa a vari processi cognitivi, tra cui l’attenzione, il pensiero e la creatività, riconoscendo loro un’autonomia strutturale e un’interdipendenza reciproca.

Il Cognitivismo ha contribuito allo sviluppo di modelli computazionali e strutture di elaborazione delle informazioni nelle Scienze Cognitive, consentendo ai ricercatori di studiare le capacità e i meccanismi cognitivi della mente. Ha fornito approfondimenti sull’interpretazione degli stati e dei processi mentali, sottolineando il ruolo dei processi cognitivi interni nel comportamento manifesto.

Figure Chiave e i Loro Contributi Fondamentali

George A. Miller: Uno dei suoi contributi più famosi è l’articolo del 1956 intitolato “The Magical Number Seven, Plus or Minus Two: Some Limits on Our Capacity for Processing Information”. In questo articolo, Miller ha sostenuto che la capacità di elaborazione della memoria a breve termine umana è limitata a circa sette unità di informazione, più o meno due. Questo concetto è stato cruciale per la nostra comprensione di come gli esseri umani elaborano e memorizzano informazioni. Nel 1960 Miller, Eugene Galanter e Karl Pribram proposero di sostituire la sequenza stimolo-risposta con un’altra sequenza comportamentale ipotizzata, che chiamarono TOTE (Test, Operate, Test, Exit), un framework per la risoluzione dei problemi che prevede una serie di passaggi: testare lo stato corrente, operare sull’ambiente per raggiungere un obiettivo, testare nuovamente per determinare se l’obiettivo è stato raggiunto e uscire dal processo una volta raggiunto l’obiettivo. Il TOTE ha avuto un impatto significativo sulla psicologia, perché ha fornito un modello realistico di come gli esseri umani perseguono gli obiettivi e realizzano i piani. Il lavoro di Miller ha incoraggiato i ricercatori ad abbandonare l’approccio più ristretto, orientato al comportamento e basato su stimolo-risposta, enfatizzando l’importanza di studiare i processi mentali interni, come la percezione, la memoria e il pensiero.

Allen Newell e Herbert A. Simon: Hanno sviluppato il concetto di “problem-solving” tramite l’intelligenza artificiale, creando programmi che imitavano il pensiero umano. Newell e Simon hanno sviluppato uno dei primi modelli di problem solving chiamato “General Problem Solver” (GPS). Questo modello rappresenta una simulazione di come le persone affrontano e risolvono problemi. Questi studiosi hanno inoltre proposto una teoria dell’apprendimento basata su simboli e regole, sostenendo che l’apprendimento umano coinvolge l’acquisizione e l’uso di simboli e regole per risolvere problemi. Newell e Simon sono stati pionieri nell’applicazione della teoria dell’Intelligenza Artificiale (IA) alla creazione di programmi e algoritmi che potessero risolvere problemi complessi. Hanno sviluppato il programma “Logic Theorist”, uno dei primi programmi di IA in grado di dimostrare teoremi matematici. I due studiosi hanno anche studiato il processo decisionale umano, introducendo il concetto di “razionalità limitata”, sostenendo che, a causa delle limitazioni cognitive e delle risorse limitate, gli individui prendono decisioni che possono essere solo razionali rispetto alle informazioni e alle risorse disponibili. In sintesi, il contributo di Allen Newell e Herbert A. Simon è stato cruciale nel collegare la psicologia cognitiva all’intelligenza artificiale e nello sviluppo di modelli e teorie che hanno influenzato notevolmente la comprensione dei processi mentali umani, dell’apprendimento, del problem solving e del processo decisionale.

Ulric Neisser: È stato pioniere nella psicologia cognitiva, introducendo il concetto di “percezione selettiva” e promuovendo l’importanza dell’ecologia della mente nella comprensione dell’esperienza umana. Neisser sostiene che la percezione non è un processo passivo di registrazione oggettiva del mondo esterno, ma piuttosto un processo attivo in cui il cervello seleziona, organizza e interpreta le informazioni sensoriali in base alle esperienze passate e agli obiettivi attuali dell’individuo. L’idea di “cognizione ecologica” suggerisce che per comprendere appieno la mente umana è necessario considerare l’ambiente in cui un individuo opera. Neisser ha lavorato anche su modelli di elaborazione delle informazioni che riflettono la metafora mente-computer. Nel suo libro “Cognitive Psychology” (1967), Neisser ha esaminato l’analogia tra il funzionamento della mente umana e il funzionamento di un computer, proponendo la visione della mente come un sistema di elaborazione delle informazioni, in cui le informazioni vengono ricevute, elaborate e memorizzate. Questo approccio ha contribuito a consolidare la concezione della mente come un elaboratore di informazioni, concetto fondamentale del cognitivismo. Tuttavia, Neisser ha anche sottolineato l’importanza di considerare l’aspetto ecologico e situazionale dell’esperienza umana nella comprensione dei processi cognitivi. Neisser ha avuto un impatto duraturo sulla psicologia cognitiva, spingendo i ricercatori a considerare la complessità e la natura dinamica della mente umana.

Noam Chomsky: Ha cambiato il modo in cui comprendiamo il linguaggio umano con la sua teoria del “grammaticalismo generativo”. La teoria della grammatica generativa di Chomsky, esposta per la prima volta nel suo libro “Syntactic Structures” del 1957, sostiene che la capacità di produrre e comprendere il linguaggio è innata e universale tra gli esseri umani e propone che ciascuna lingua naturale è governata da una grammatica sottostante che può essere descritta attraverso regole formali. Il concetto di “Universal Grammar” (Grammatica Universale) suggerisce che esiste un insieme di principi linguistici condivisi da tutte le lingue umane, che costituiscono la base per la capacità innata di apprendere qualsiasi lingua naturale. La teoria di Chomsky sulla grammatica generativa ha avuto un impatto significativo su discipline come la psicologia cognitiva, le neuroscienze cognitive e l’intelligenza artificiale. Egli ha contribuito alla comprensione della struttura della mente umana attraverso la sua teoria del “modularismo”, sottolineando l’esistenza di specifici moduli mentali per varie funzioni cognitive.

La teoria linguistica di Noam Chomsky

David Rumelhart e l'Ascesa del Connessionismo

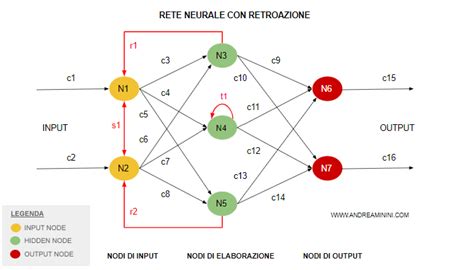

David Rumelhart è stato una figura prominente nella scienza cognitiva, noto per i suoi contributi allo sviluppo di modelli connessionisti della cognizione. Ha giocato un ruolo cruciale nel far progredire la comprensione delle reti neurali, che simulano i processi di pensiero umano, enfatizzando l'elaborazione parallela e l'importanza dell'apprendimento attraverso l'esperienza.

Rumelhart è ben noto per il suo lavoro sul framework del "Parallel Distributed Processing" (PDP), co-autore di un libro fondamentale che ha gettato le basi per gli approcci connessionisti. Ha proposto che la conoscenza sia rappresentata in pattern di attivazione attraverso reti piuttosto che in simboli discreti, segnando un cambiamento rispetto alle teorie cognitive tradizionali. La sua ricerca ha dimostrato come i modelli connessionisti possano spiegare efficacemente varie funzioni cognitive, tra cui l'elaborazione del linguaggio e la memoria. Il lavoro di Rumelhart ha enfatizzato il significato degli algoritmi di apprendimento che consentono alle reti di aggiustare i pesi in base all'esperienza, migliorando le loro prestazioni nel tempo. Ha anche contribuito alla comprensione dello sviluppo cognitivo, proponendo che l'apprendimento avvenga attraverso cambiamenti graduali nella struttura e nella funzione della rete.

Nato nel 1942, Rumelhart ha studiato all'University of South Dakota e ha conseguito il dottorato di ricerca all'Università di Stanford. Nel corso del suo lavoro ha ricevuto numerosi premi, tra cui il MacArthur Fellows Program nel 1987. Nel 1986 ha pubblicato, insieme a Geoffrey Hinton e Ronald J. Williams, un articolo di particolare influenza sull'uso dell'algoritmo di retropropagazione dell'errore per l'allenamento di reti neurali multistrato. Nel 2000 è stato istituito il Premio Rumelhart per i contributi ai fondamenti teorici della cognizione umana. Nel 2002, un sondaggio della Review of General Psychology lo ha classificato come l'ottantottesimo psicologo più citato del XX secolo.

Il connessionismo, di cui Rumelhart è stato un pioniere, suggerisce un modello distribuito per la rappresentazione delle informazioni nella memoria. Le informazioni all'interno di una rete neurale (biologica o artificiale) sono distribuite in tutti i vari nodi della rete e non in un sito specifico. Dal punto di vista della filosofia della mente, il connessionismo si pone come alternativa al cognitivismo, mettendone in discussione il postulato fondamentale, ovvero l'analogia tra mente e computer. Nell'ottica connessionista, il computer diviene mero strumento di calcolo del ricercatore, mentre l'analogia funzionale si sposta sul cervello umano e sulle reti neurali biologiche. L'attività della mente è distribuita tra le connessioni delle unità di calcolo (i "neuroni"), perciò non scomponibile nei singoli processi cognitivi. In una rete neurale artificiale ogni "nodo" rappresenta l'ipersemplificazione di un neurone biologico, simulando il suo comportamento attraverso connessioni analoghe alle sinapsi e una funzione di attivazione che stabilisce quando il neurone invia un segnale. Molti vedono il connessionismo in opposizione al simbolismo, una forma specifica del cognitivismo che sostiene che l'attività mentale sia solo calcolo, operando essenzialmente come una macchina di Turing.

L'Evoluzione delle Scienze Cognitive: Dal Modello Computazionale alla Cognizione Incarnata

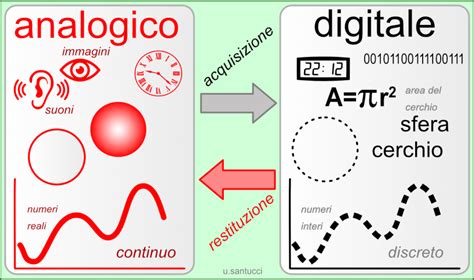

Tra gli anni Cinquanta e Settanta, l'incontro tra diverse discipline, guidate dall'idea che il cervello funzionasse come un computer, motivò la fondazione della scienza cognitiva. Sebbene i vantaggi di un approccio interdisciplinare fossero evidenti, la coesione tra le discipline è diminuita, portando oggi a parlare di "scienze cognitive" al plurale. La scienza cognitiva, nata nel 1979 come disciplina singolare, mirava a combinare orientamenti diversi per lo studio scientifico e multidisciplinare del cervello. I computer, ricevendo informazioni in input e elaborandole, erano visti come un modello del funzionamento cerebrale. Questo confronto cervello-computer era alimentato dall'idea che il cervello operasse attraverso processi computazionali, ovvero operazioni su simboli guidate da precise istruzioni.

Il comportamentismo, nato nel 1913 con l'articolo di J. Watson, dominò la psicologia negli Stati Uniti, focalizzandosi esclusivamente sul comportamento osservabile (stimoli e risposte) e ignorando gli eventi mentali. Negli anni '50, tuttavia, un numero crescente di psicologi, influenzati dall'informatica e da studiosi europei, si rese conto che era necessario "aprire la scatola nera" tra stimolo e risposta per comprendere le ragioni delle azioni. La nuova idea dominante era che il cervello lavorasse come un computer.

La linguistica, negli anni '50, fu rinnovata da Noam Chomsky con la sua teoria sulla capacità innata di acquisizione del linguaggio, il "dispositivo biologico innato" e la "grammatica universale". Questa teoria, con un'impostazione computazionale, suggeriva che il linguaggio è governato da regole che agiscono su simboli.

La rivista Cognitive Science fu fondata nel 1977, seguita dalla nascita della Society for Cognitive Science nel 1979, che includeva anche filosofia, antropologia e neuroscienze. Queste ultime potevano correlare l'elaborazione delle informazioni a un substrato anatomo-funzionale.

Attualmente, diversi scienziati preferiscono parlare di scienze cognitive al plurale, sentendo che la natura multidisciplinare del progetto si è persa. La cognizione può essere studiata sia nell'uomo che nelle macchine, con l'intelligenza artificiale che gioca un ruolo fondamentale nello studio dei meccanismi mentali umani. Tuttavia, sebbene questi aspetti siano stati centrali fino agli anni '90, sono emerse nuove teorie che hanno messo in discussione la centralità della computazione e il presunto riduzionismo della scienza cognitiva, che aveva trascurato il ruolo dei fattori biologici, affettivi e culturali.

Il filosofo P. Thagard, nel 2005, affermava che il pensiero può essere meglio compreso in termini di rappresentazioni della conoscenza e di processi cognitivi computazionali che le elaborano. Le rappresentazioni possono essere simboliche (basate su convenzioni) o analogiche (strutturali, come le immagini). La rappresentazione distribuita è funzionale alla rappresentazione di più concetti. I processi cognitivi superiori sono meccanismi di calcolo che lavorano sulle rappresentazioni, responsabili dell'acquisizione, immagazzinamento, interpretazione e manipolazione della conoscenza.

Storicamente, gli aspetti relativi all'apprendimento delle informazioni sono stati trascurati dalle scienze cognitive, mentre campi come la pianificazione, il pensiero e il problem solving sono stati più studiati. La pianificazione è l'abilità di raggiungere un obiettivo attraverso una serie di mosse. Il pensiero, pur essendo un processo interno non osservabile, può essere studiato attraverso dati comportamentali. Il ragionamento, una proprietà del pensiero, permette di manipolare e combinare i concetti, attraverso il ragionamento deduttivo (basato su modelli mentali) o induttivo (partendo da fatti particolari).

Secondo le scienze cognitive, i fini del pensiero sono la risoluzione dei problemi quotidiani e i processi decisionali. Per raggiungere un obiettivo, le persone utilizzano operatori e algoritmi, o scorciatoie come le euristiche (ad esempio, l'analisi mezzi-fini).

Nonostante i benefici dell'unione tra psicologia, intelligenza artificiale e linguistica, la scienza cognitiva non ha mai avuto un framework teorico condiviso, assumendo l'idea che la mente lavori secondo processi computazionali. Questo ha portato all'insoddisfazione di diversi ricercatori e alla percezione di un "riduzionismo deliberato" che ha trascurato fattori culturali, affettivi e ambientali.

Paradossalmente, le scienze cognitive hanno iniziato a mettere in dubbio i propri principi con la pubblicazione di "Parallel Distributed Processing" da parte di Rumelhart e McClelland nel 1987. Un computer, pur programmabile, opera diversamente dal cervello. Il cervello, con i suoi miliardi di neuroni, è un elaboratore parallelo, in grado di dividere procedure complesse in molteplici sotto-procedure elaborate da moduli neurali.

L'Impatto del Deep Learning e la Teoria 4E

L'intelligenza Artificiale (IA), energizzata dal "deep learning", ha ottenuto successi inaspettati, ma ha anche sollevato interrogativi su principi teorici consolidati riguardanti l'intelligenza umana. La tesi, maturata nelle scienze cognitive e nella filosofia, secondo cui l'intelligenza è indissolubilmente legata al corpo fisico, sembra essere messa in discussione dai successi del deep learning in compiti che richiedono cognizione senza un "corpo" fisico.

L'IA ha avuto un duplice intento: coadiuvare lo studio della cognizione umana e migliorare algoritmi informatici ispirandosi all'intelligenza umana. Il deep learning, evoluzione delle reti neurali artificiali, inizialmente mirava a offrire nuovi strumenti per comprendere la cognizione umana, ma oggi mostra una sostanziale indifferenza verso quest'ultima.

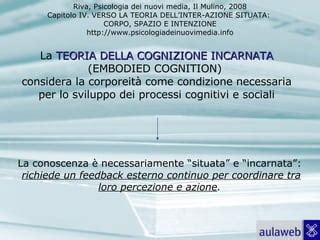

Le scienze cognitive hanno vissuto profondi cambiamenti, passando da una visione della mente come collezione di processori di informazioni a un'enfasi crescente sul corpo fisico. La teoria della cognizione 4E (Embodied, Embedded, Enactive, Extended) sostiene che l'intelligenza è indissociabile dal corpo, immersa nell'ambiente, interagisce con esso e si estende negli strumenti utilizzati.

Tuttavia, la fenomenologia e altre correnti filosofiche hanno influenzato la scienza cognitiva, portando alcuni studiosi a contestare il primato del cervello nella cognizione. Sebbene queste suggestioni siano affascinanti, comportano il rischio di abbandonare i metodi scientifici rigorosi. Altre correnti della cognizione 4E, più legate alla pratica scientifica, studiano l'interdipendenza tra cognizione e corpo attraverso osservazioni empiriche, come gli studi sui movimenti oculari e i neuroni specchio. Questi studi mostrano un'interdipendenza tra cognizione e corpo, mediata da rappresentazioni neurali, mantenendo un certo privilegio al cervello.

Nonostante la perdita di attrattiva delle reti neurali artificiali per questa ala del cognitivismo 4E, vi sono linee di contatto con altri comparti dell'IA, in particolare la robotica. Rodney Brooks, protagonista della svolta embodied, ha proposto una robotica in cui l'intelligenza emerge dall'esigenza di muovere un corpo artificiale in un ambiente.

L'avvento del deep learning, tuttavia, ha surclassato algoritmi di visione precedenti, raggiungendo prestazioni pari a quelle umane nel riconoscimento di oggetti in immagini, in modo puramente computazionale e senza alcuna delle "E" della cognizione 4E. Questo solleva interrogativi sulla natura dell'intelligenza umana, poiché studi hanno riscontrato impressionanti concordanze tra le configurazioni di attivazioni dei neuroni biologici e quelli dei modelli deep learning.

La Scienza Cognitiva Neurale e la Continua Evoluzione

La scienza cognitiva, nata dalla "rivoluzione cognitiva" anticomportamentista, inizialmente si basava sull'analogia mente-computer, considerata una macchina che opera formalmente su simboli secondo regole. Questa visione computazionale ha reso legittimo l'uso di concetti mentalistici per spiegare il comportamento, integrando psicologia cognitiva, linguistica formale e informatica. L'intelligenza artificiale mirava a dotare i computer di capacità cognitive umane.

Verso la metà degli anni Ottanta, tuttavia, è emersa la scienza cognitiva neurale, ispirata al sistema nervoso e alle reti neurali. Questi modelli simulativi, che riproducono in modo semplificato le caratteristiche fisiche del sistema nervoso, hanno portato a interrogarsi sui principi della scienza cognitiva computazionale. La scienza cognitiva neurale condivide l'approccio interdisciplinare e l'uso del computer, ma differisce nel mix disciplinare (psicologia non necessariamente cognitivista, neuroscienze) e nella concezione del ruolo del computer come modello del sistema nervoso.

L'impatto culturale generale della scienza cognitiva computazionale è stato significativo, modificando il concetto di macchina e rafforzando il dualismo mente-corpo. Il computer, con il suo hardware (naturale) e software (non naturale ma meccanico), è diventato un modello di questa dualità.

Oggi, le scienze cognitive continuano a evolversi, nutrendosi di nuove tecnologie e approcci multidisciplinari. L'integrazione dell'intelligenza artificiale, l'analisi dei dati e la ricerca di nuovi modelli e teorie per spiegare fenomeni mentali ancora sconosciuti sono sfide attuali. Il viaggio verso la comprensione della mente umana è un processo continuo, in cui l'eredità di pionieri come David Rumelhart continua a fornire le basi per future scoperte.

tags: #scienza #cognitiva #rumelhart